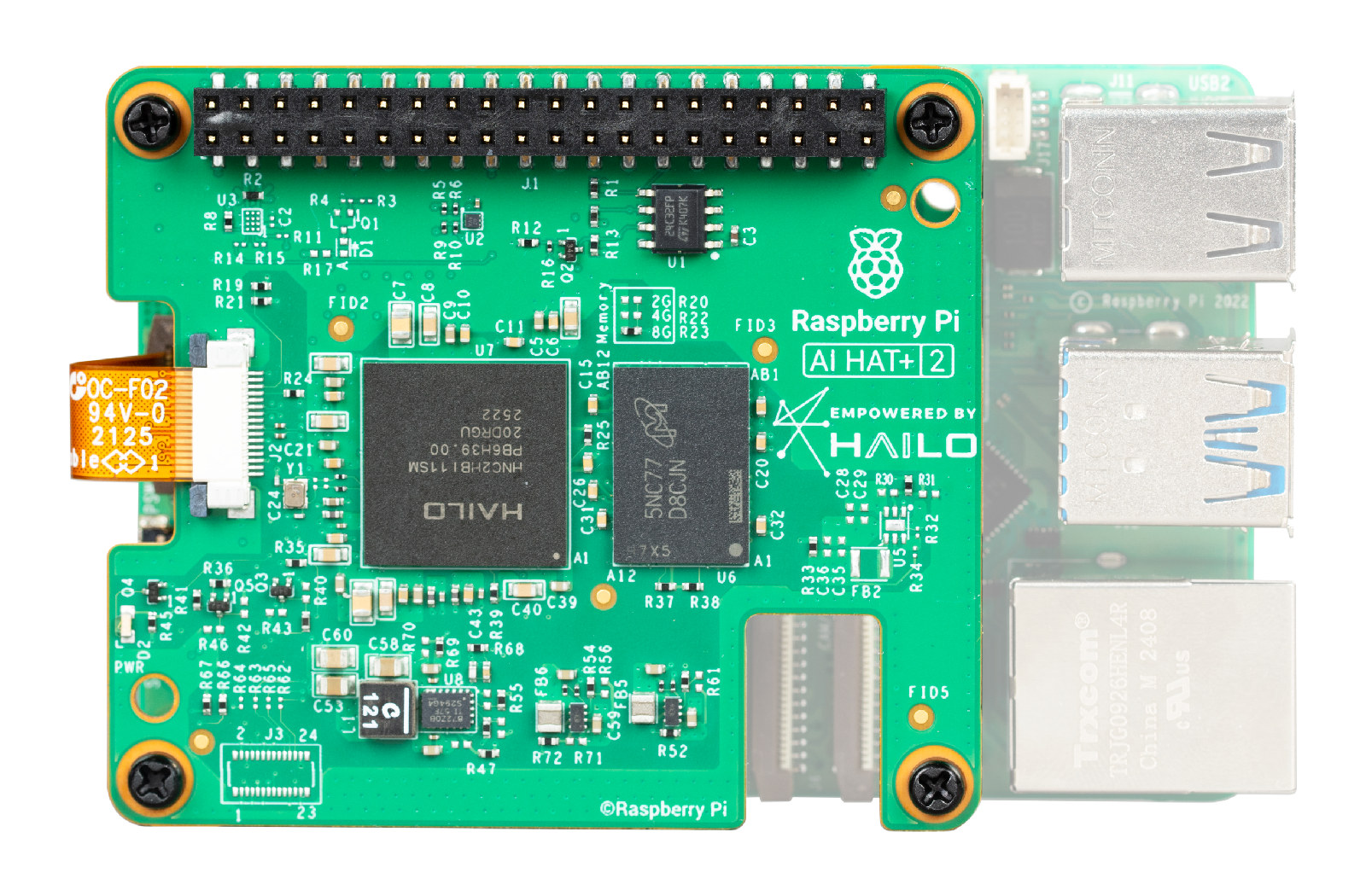

Raspberry Pi AI HAT+ 2: Execute LLMs Localmente por Apenas $130

O Raspberry Pi AI HAT+ 2 traz LLMs locais para a borda com o chip Hailo 10H, 8GB de RAM dedicada e suporte para DeepSeek, Llama e Qwen - tudo rodando offline com apenas 3 watts.

A Ascensão da IA Soberana na Borda

Por anos, a promessa da IA Generativa esteve atrelada à nuvem. Essa dependência frequentemente vem com obstáculos significativos: alta latência, custos de assinatura recorrentes e complexas preocupações com a privacidade dos dados. No entanto, o cenário da computação de borda acaba de passar por uma mudança sísmica. O lançamento do Raspberry Pi AI HAT+ 2 marca um ponto de virada, oferecendo uma solução de alto desempenho e baixo consumo de energia para executar Large Language Models (LLMs) localmente por um investimento único de hardware de apenas $130.

A capacidade de implementar modelos como DeepSeek, Llama e Qwen em um dispositivo que cabe na palma da sua mão - e consome apenas 3 watts de energia - abre portas sem precedentes para IoT industrial, interfaces de voz seguras e automação empresarial localizada em qualquer setor.

Avanço Técnico: O Hailo 10H e 8GB de RAM Dedicada

O núcleo do Raspberry Pi AI HAT+ 2 é o Hailo 10H AI Acceleration Module. Enquanto aceleradores de IA anteriores para o Pi se concentravam principalmente em visão computacional e detecção de objetos, o AI HAT+ 2 é explicitamente projetado para a era generativa. Ele oferece até 40 TOPS (Tera Operations Per Second) de desempenho, mas a verdadeira inovação do hardware reside em sua arquitetura de memória.

Memória Dedicada para Grandes Modelos

Ao contrário dos complementos NPU padrão que compartilham a RAM do sistema host, o AI HAT+ 2 possui 8GB de RAM LPDDR4x dedicada. Isso é crítico para a implantação de LLM. O gargalo raramente é apenas computação - é largura de banda e capacidade de memória. Ao fornecer 8GB de espaço dedicado, o HAT permite que o Raspberry Pi 5 carregue pesos de modelo inteiramente no acelerador, liberando os recursos do Pi para a lógica do aplicativo.

- Chipset: Hailo 10H AI Processor

- Desempenho: 40 TOPS (INT4)

- Memória: 8GB RAM LPDDR4x Dedicada

- Energia: ~3 Watts sob cargas de trabalho típicas

- Interface: PCIe 3.0 via conector FPC Raspberry Pi 5

- Preço: $130

Modelos Suportados: DeepSeek, Llama e Qwen

A característica mais atraente é o suporte verificado para arquiteturas LLM modernas. Através do Hailo Model Zoo e pilhas de software otimizadas, o AI HAT+ 2 executa versões quantizadas de modelos de código aberto líderes:

DeepSeek-R1-Distill (1.5B)

DeepSeek ganhou grande popularidade por sua eficiência de raciocínio. O modelo R1 destilado é executado sem problemas no AI HAT+ 2, perfeito para assistência de codificação, raciocínio em cadeia de pensamento e tarefas especializadas dentro de uma rede fechada.

Llama 3.2 da Meta (1B)

Llama 3.2 é o padrão da indústria para IA local de propósito geral. Com 40 TOPS de potência, o AI HAT+ 2 atinge taxas de token por segundo utilizáveis para aplicações de chat em tempo real - viável para quiosques de atendimento ao cliente ou bases de conhecimento internas.

Família Qwen 2.5 da Alibaba (1.5B)

Qwen 2.5 inclui variantes Instruct e Coder, oferecendo fortes capacidades multilingues e geração de código. Executar Qwen localmente garante respostas de latência zero sem custos de API.

Por Que Executar LLMs Localmente?

1. Privacidade e Segurança de Dados

Quando a IA é executada localmente, os dados nunca saem do dispositivo. Não há risco de que dados confidenciais sejam usados para treinar modelos de nuvem de terceiros. Esta abordagem de "IA isolada" é essencial para aplicações de saúde, finanças, jurídica e governamentais.

2. Latência Zero

As chamadas de API na nuvem introduzem latência de rede. A inferência local fornece respostas instantâneas - críticas para interfaces de voz, automação em tempo real e aplicações interativas.

3. Sem Custos Recorrentes

As APIs de IA na nuvem cobram por token. Para casos de uso de alto volume, os custos aumentam rapidamente. O AI HAT+ 2 é um investimento único de $130 com inferência local ilimitada.

4. Operação Offline

Dispositivos de borda geralmente operam em ambientes onde a internet é não confiável ou indisponível. Um dispositivo de 3 watts alimentado por energia solar ou bateria pode fornecer diagnósticos inteligentes e interfaces de voz em qualquer lugar.

Casos de Uso Práticos

- Assistentes de Voz Locais: Processar fala para texto e respostas LLM sem dependência da nuvem

- IoT Industrial: Manutenção preditiva e diagnósticos na borda

- Varejo Inteligente: Quiosques alimentados por IA que funcionam offline

- Escritórios Inteligentes com Prioridade na Privacidade: Assistentes de sala de reunião que não transmitem dados externamente

- Robótica: Inteligência incorporada para sistemas autônomos

- Educação: Laboratórios de IA acessíveis para escolas e universidades

Considerações de Implementação

Executar LLMs em hardware de borda requer quantização - compactar pesos de modelo de 16 bits para 4 bits ou 8 bits para caber dentro do envelope de memória de 8 GB. Isso reduz ligeiramente a capacidade do modelo, mas a compensação em velocidade, privacidade e custo geralmente é preferida para tarefas específicas.

O resfriamento também é importante. Apesar do baixo consumo de energia de 3W, o Raspberry Pi 5 e o AI HAT+ 2 devem ser alojados em um gabinete de resfriamento ativo para sessões de inferência sustentadas.

Começando

O AI HAT+ 2 está disponível agora em revendedores oficiais do Raspberry Pi. Você precisará de:

- Raspberry Pi 5 (8GB recomendado)

- Raspberry Pi OS atualizado

- Solução de resfriamento ativo

Verifique a documentação oficial e o GitHub da Hailo para downloads de modelos e guias de configuração.

Conclusão: O Futuro é Local

O Raspberry Pi AI HAT+ 2 não é apenas uma ferramenta para amadores - é um acelerador de nível profissional que democratiza a IA local. Por $130, você obtém um dispositivo que executa modelos DeepSeek, Llama e Qwen completamente offline, sem custos de API, sem latência e com total privacidade de dados.

A era da IA soberana na borda chegou. A questão não é se deve implantar a IA localmente - é o quão rápido você pode começar.

Escrito por

Optijara AI